Představte si, že se vracíte z dovolené a čeká vás šokující účet za škodu, kterou jste podle pronajímatele způsobili. Většina z nás by se bránila, ale co když důkazní materiál je zmanipulovaný? Jeden případ u Airbnb odhalil, jak snadno může být umělá inteligence zneužita k výrobě falešných důkazů a jak složité je to v dnešní době rozlišit.

Tento článek vám ukáže, jak si ověřit pravost fotografií a proč je video důležitější než kdy dříve.

Skrytá zbraň v digitální éře: ‚Halucinace‘ umělé inteligence

Všechno začalo na první pohled nevinně – prasklina na dřevěném konferenčním stolku v jedné z fotografií nahraných do systému Airbnb. V jednom snímku se trhlina táhla podél kresby dřeva. V druhém, tentýž stůl, ale prasklina se podivně posunula a změnila tvar i směr.

Pro automatizované systémy a pracovníky podpory Airbnb byly tyto snímky dostatečným důkazem k vymáhání tisíců dolarů od hostky. Pro digitálního forenzního experta to však bylo něco mnohem zlověstnějšího: prasklina byla s největší pravděpodobností „vykouzlená“ generativní umělou inteligencí.

Případ z Manhattanu: Superhostitel vs. akademik

Tento incident mezi prominentním hostitelem z Manhattanu a londýnskou akademičkou se stal klíčovou případovou studií v otázce zneužití syntetických médií. Ukázalo se, jak snadno mohou nástroje určené k tvorbě umění nebo úpravě fotografií z dovolené posloužit k vytvoření falešných důkazů o událostech, které se nikdy nestaly.

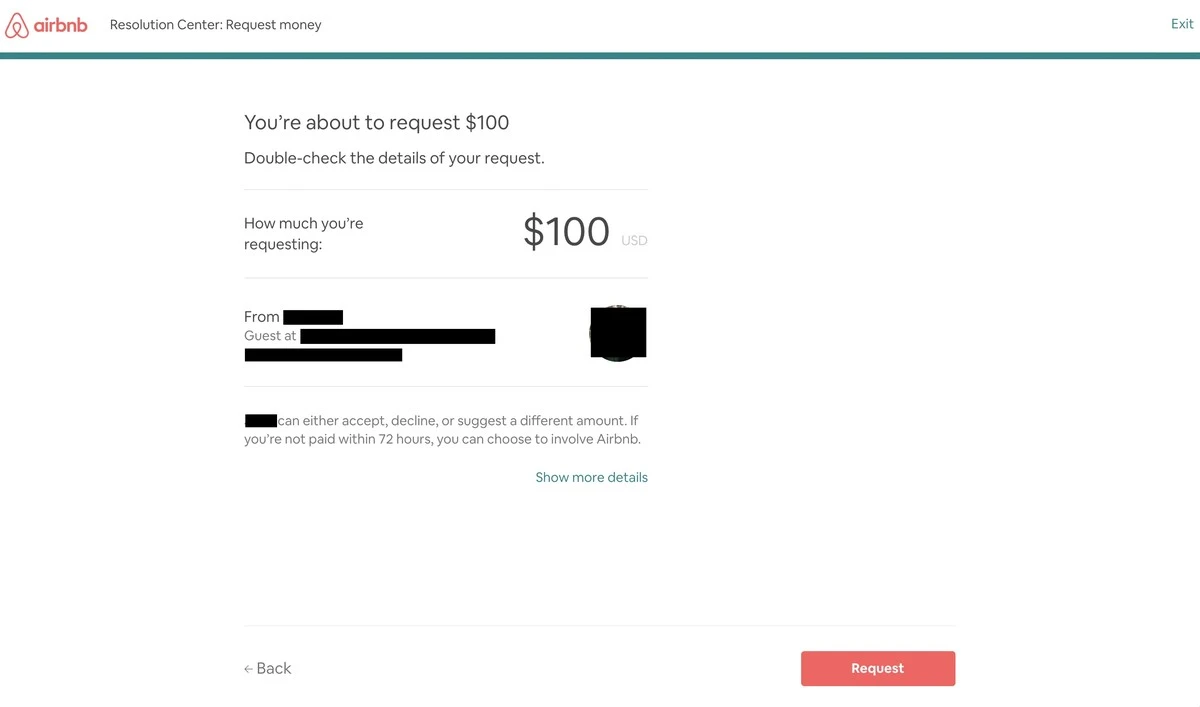

Hostka se z apartmánu odstěhovala dříve z obav o svou bezpečnost. Brzy poté hostitel podal přes program AirCover od Airbnb žádost o náhradu škody přesahující 9 000 dolarů. Podle serveru The Guardian seznam údajně zničených věcí byl rozsáhlý: matrace potřísněná močí, rozbitý robotický vysavač a nechvalně proslulý prasklý stůl.

Kdy selhává automatizovaná důvěra

Podle digitálních forenzních expertů je toto typický znak generativního „in-paintingu“. Když uživatel požádá AI o přidání praskliny na objekt, model vygeneruje statisticky pravděpodobný obraz poškození. Pokud uživatel zopakuje pokyn pro jiný úhel pohledu, AI vygeneruje novou prasklinu, místo aby vykreslila tentýž fyzický objekt z jiné perspektivy. AI chápe, jak vypadá poškozený stůl, ale nerozumí konceptu trvalosti objektů.

V tomto konkrétním případě Airbnb původně stálo na straně hostitele a požadovalo po hostce téměř 5 314 liber. K nápravě došlo až po intervenci novinářů zabývajících se ochranou spotřebitele a prezentaci vizuálních anomálií. Platforma pak rozhodnutí zrušila, vrátila hostce peníze a smazala negativní hodnocení hostitele.

Zranitelnost automatizovaného řešení sporů

Pro platformy spravující miliony rezervací je škálovatelnost řešení sporů silně závislá na automatizaci. Pojištění jako AirCover je navrženo tak, aby bylo bezproblémové a často rychle vyplácelo hostitelům, aby si udrželo jejich loajalitu. Tato rychlost však vytváří zranitelnost, kterou uměle vytvořené důkazy zneužívají.

Hlavním problémem je, že standardní systémy ověřování obrazu v roce 2025 byly primárně postaveny na detekci manipulace s metadaty, jako jsou pozměněné datumy nebo GPS tagy, nikoli na generování na úrovni pixelů. Fotografie „rozbité televize“ generované zcela AI neobsahuje žádné stopy po vrstvách Photoshopu, protože nebyla tradičně editována; byla vytvořena kompletní.

Posun v řešení vysokých nároků

Data z tohoto případu naznačují posun v tom, jak platformy řeší vysoké nároky. Hostitel v uvedeném případě byl „superhostitel“, což je status, který historicky poskytoval uživatelům jistou míru důvěryhodnosti. Demokratizace vysoce kvalitních AI nástrojů tuto výsadu v podstatě narušila. Pokud superhostitel dokáže vytvořit přesvědčivé fotografie koberce potřísněného vínem, aniž by si víno koupil nebo koberec zničil, systém hodnocení platformy přestává fungovat jako vrstva ověřování.

Hostka k absenci počátečního prověřování uvedla: „Tohle mělo okamžitě vzbudit podezření a zdiskreditovat tvrzení hostitele, kdyby byl důkazní materiál přezkoumán byť jen s minimální pečlivostí. Airbnb však nejenže nedokázalo tuto zjevnou manipulaci odhalit, ale zcela ignorovalo mé vysvětlení a jasný důkaz, že materiál byl zfalšovaný.“

Odvetný úder: Video jako ultimátní obrana

Technickou výzvou pro průmysl je, že detekční nástroje zaostávají za nástroji pro generování. Ačkoli standardy jako C2PA (Coalition for Content Provenance and Authenticity) se snaží do souborů vkládat digitální nutriční štítky odolné proti neoprávněné manipulaci, tyto protokoly ještě nejsou univerzálně přijaty kamerami nebo softwarem používaným běžnými hostiteli a hosty.

Dokud se kryptograficky podepsané fotografie nestanou průmyslovým standardem, břemeno důkazů se agresivně přesunulo na stranu uživatele. Právní experti v oblasti cestování nyní radí, že video procházka, tedy nepřerušovaný záznam nemovitosti při příjezdu a odjezdu, je jedinou spolehlivou obranou proti syntetickým nárokům. Na rozdíl od statických obrázků je video v současné době mnohem náročnější na zdroje, než aby bylo přesvědčivě zfalšováno pomocí AI, zejména při pohybu složitými prostorovými prostory s proměnlivými světelnými podmínkami.

Incident z Manhattanu nakonec skončil vrácením peněz a zákazem činnosti, ale signalizoval konec éry neformální důvěry. Schopnost vyrábět realitu již není výsadou státních aktérů nebo studií na speciální efekty; je to problém zákaznických služeb. Airbnb od té doby oznámilo interní přezkum svých vyšetřovacích protokolů s cílem řešit problém podvodů generovaných AI.

A co vy? Už jste se setkali s podivnou manipulací na internetu nebo falešnými důkazy? Podělte se v komentářích!